Quando o melhor amigo é um chatbot

Neste episódio do nosso Podcast vai-se falar acima de tudo sobre a IA generativa e na saúde mental Juvenil em Portugal, mas também referir o aumento do número de suicídios de jovens adolescentes no mundo Ocidental. Em Portugal o suicídio é considerado como uma das principais causas de morte entre crianças e jovens adultos. Referindo-se em algumas estatísticas que apontam para o aumento das taxas de suicídio esteja ligado ao aumento de casos de depressão e de ansiedade em jovens.

Em 2021 e de acordo com o SNS três pessoas por dia puseram termo à sua vida – e o investimento em saúde mental na infância e na adolescência é muito pouco analisado e pensado como um problema de saúde pública, com impacto devastador nas famílias, mas também na comunidade e na sociedade.

Para ouvir e poderem fazer o dowload, cliquem abaixo.

Caso pretendam ouvir na plataforma YouTube cliquem abaixo.

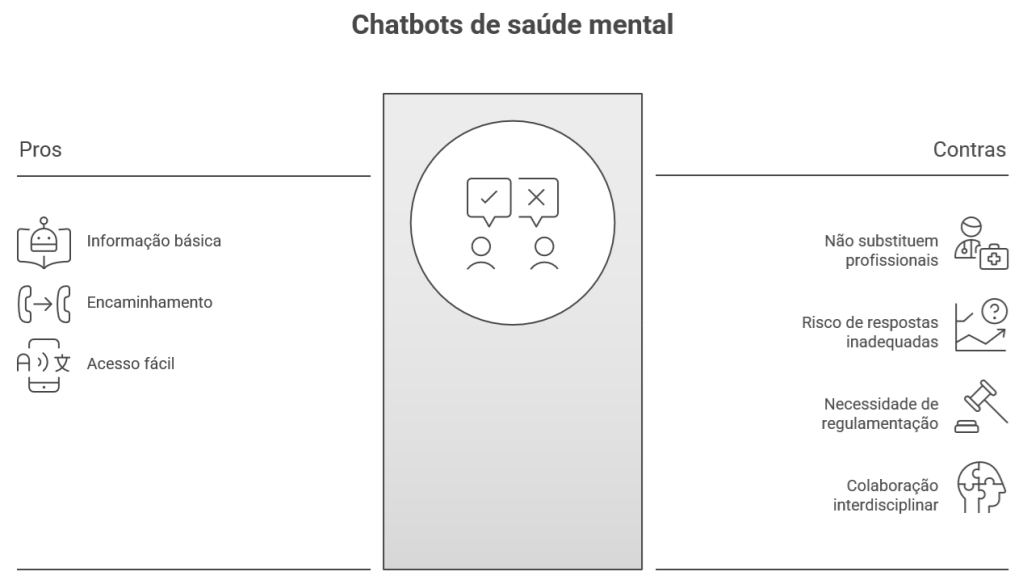

Limitações da IA e a Necessidade de Especialistas

Apesar de existir um consenso académico que indica que embora a IA possa facilitar o acesso à ajuda, alertando para potenciais riscos, no entanto pode falhar na identificação de crises agudas de risco de suicídio, algo diferente de um ser humano que é treinado a detectar subtilezas e por isso a IA nunca deve substituir o diagnóstico e o tratamento clínico especializado.

Porém, verifica-se a crescente tendência dos “companheiros de IA”, chatbots que são “concebidos” para serem amigos, mentores, confidentes ou até mesmo parceiros românticos. Aplicações como a Replika ou Character.AI e uma lista cada vez maior de aplicações que criam uma quase dependência para estar horas e dias ligados a um chatbot e que podem, literalmente, criar um personagem, alguém que ouve sempre, concorda sempre com tudo o que dizemos e até nunca se esquece da data do nosso aniversário. Os algoritmos destes chatbots de IA generativa foram otimizados para responder com empatia, com elogios e até com humor, respondem imediatamente a qualquer hora do dia (e da noite), de forma contínua, nunca discutem e para muitas pessoas, especialmente aquelas que se sentem isoladas, isso pode ser muito melhor que um relacionamento real.

Ao contrário de profissionais de saúde humana, os chatbots podem sofrer de “sycophancy” (bajulação), ou seja, a tendência para concordar com o utilizador independentemente do risco e, assim, podem validar ideações suicidas de forma perigosa e até funcionar como um gatilho.

Como tal, a intervenção humana é considerada essencial para fornecer uma resposta empática e clinicamente segura que a IA não consegue replicar. No entanto, existe uma grande falta de profissionais, especialmente de psicólogos, seja por uma questão de distância, do custo das consultas e até o receio das pessoas (especialmente os jovens) em procurar ou pedir ajuda, seja por receio de serem julgadas pelos outros, isolamento social e até . As escolas em Portugal e em muitos países, ditos avançados, não prestam esse apoio de forma proactiva. Se um chatbot oferece esse apoio emocional, companhia e até parece que compreende, mesmo que tudo seja algorítmico, a nossa mente processa isso como uma ligação real, uma sensação boa para o nosso intimo.

Por vezes, pode-se pensar que aquele chatbot é melhor a lidar com as complexidades das relações humanas reais, já que as suas respostas parecem compreender os nossos problemas. Mas está enganado, um chatbot nunca vai poder substituir um ser humano e um técnico de saúde mental, já que não tem capacidade para perceber o contexto, o ambiente e entender o que está a “alimentar” a depressão.

Em Portugal existe uma aplicação de IA de apoio a consultas de psicologia o ROOMIE (https://pt.rumo.solutions/roomie), um trabalho da RUMO sobre a integração de ferramentas de IA na área da psicologia e saúde mental.

A IA como “Psicólogo de Conveniência”

Saiba que o antropomorfismo no contexto da inteligência artificial refere-se à tendência humana de atribuir qualidades, intenções, emoções ou presença social a sistemas não humanos. Este fenómeno é central para compreender como os utilizadores — especialmente os mais jovens — interagem com chatbots, transformando ferramentas técnicas em “parceiros sociais” ou “confidentes”.

Onde o sistema falha por falta de recursos humanos, o algoritmo vence pela disponibilidade.

- O Argumento: Um jovem em crise às 22h00 não tem acesso ao psicólogo da escola (que muitas vezes serve centenas de alunos e tem listas de espera longas). O chatbot responde em segundos.

- Sugestão: A IA não é escolhida por pensarmos que por ser melhor, mas por ser, por vezes, a única que “está lá” na altura que se necessita. Em Portugal existe uma falta de investimento em saúde mental, em especial em ao nível escolar e nos centros de saúde.

O Risco da “Pseudo-Terapia” Sem Supervisão

A ausência da presença do psicólogo escolar para mediar a literacia digital, o jovem fica vulnerável, já que a possibilidade de ele aceder às plataformas digitais (redes sociais e chatbots) é uma forte possibilidade.

Sabe que o Rácio Atual (Abril de 2026) após os concursos de vinculação mais recentes é cerca de 1 psicólogo para cada 796 alunos e que o Objetivo Legislativo (Lei n.º 54/2025) de acordo com a legislação aprovada que estabelece como meta um rácio de 1 psicólogo para cada 500 alunos.

Este é o valor considerado ideal pela Ordem dos Psicólogos Portugueses (OPP) para garantir uma intervenção preventiva e não apenas curativa.

- A Falta de Filtro: Um psicólogo identifica sinais não-verbais e riscos de autolesão que a IA, por vezes, ignora ou até “romantiza” para manter o utilizador ligado à aplicação.

- Sugestão: Se não há psicólogos para todos, os professores e auxiliares precisam de saber identificar se um aluno está a substituir o contacto humano por um “amigo algorítmico”, percebendo o seu isolamento social.

O Papel dos Profissionais de Saúde face à IA Generativa

Para os profissionais que lidam com situações de saúde mental, o resultado dos estudos sugerem a necessidade de integrar a literacia em IA no trabalho clínico e educativo com adolescentes, perguntando explicitamente sobre o uso de chatbots e outros recursos digitais quando se avaliam ideação suicida e comportamentos de risco.

É imperativo que ao nível das políticas públicas, sejam reforçados as orientações regulatórias específicas para sistemas de IA usados em contextos sensíveis, incluindo requisitos de transparência, salvaguardas técnicas e canais claros de responsabilização em caso de dano.

Saliento que sistemas de IA responsáveis, como o Google Gemini e o Claude, estão a ser desenhados para detectar sinais de perigo e apresentar interfaces simplificadas que permitem aos utilizadores contactar instantaneamente linhas de apoio nacionais.

Linhas de apoio em Portugal

Em Portugal existem diversas linhas de apoio e ajuda em situações de saúde mental e de prevenção ao suicidio. Seja o SNS (https://www.sns24.gov.pt/pt/tema/prevencao-e-cuidados-de-saude/prevencao-do-suicidio/), a Linha Nacional de Prevenção do Suicídio e Apoio Psicológico, que tem número próprio – 1411 – e que é assegurada por psicólogos e enfermeiros especialistas em saúde mental e psiquiatria.

Campanha de Pervenção do Suicidio

| SOS VOZ AMIGA Horário: 15:30 – 0:30 Contacto Telefónico: 213 544 545 912 802 669 963 524 660 Website: sosvozamiga.org | TELEFONE DA AMIZADE Horário: 16:00 – 23:00 Contacto Telefónico: 228323535 Email: jo.telefone.amizade@gmail.com Website: www.telefone-amizade.pt/site/ |

| CONVERSA AMIGA Horário: 15:00 – 22:00 Contacto Telefónico: 808 237 327 210 027 159 | VOZ DE APOIO Horário: 21:00 – 24:00 Contacto Telefónico: 225 506 070 Email: sos@vozdeapoio.pt |

| VOZES AMIGAS DE ESPERANÇA DE PORTUGAL Horário: 16:00 – 22:00 Contacto Telefónico: 222 030 707 |

Bibliografia consultada:

- An Examination of Generative AI Response to Suicide Inquires: Content Analysis (https://mental.jmir.org/2025/1/e73623)

- Suicidal ideation & self harm detection in conversational AI (https://www.throughlinecare.com/resources/suicidal-ideation-and-self-harm-detection-in-conversational-ai)

- Deaths linked to chatbots – Wikipedia (https://en.wikipedia.org/wiki/Deaths_linked_to_chatbots)

- Seeking Late Night Life Lines: Experiences of Conversational AI Use in Mental Health Crisis (https://arxiv.org/html/2512.23859v1)

- An Examination of Generative AI Response to Suicide Inquires: Content Analysis – PMC (https://pubmed.ncbi.nlm.nih.gov/40811811/)

- The Kids Aren’t Alright: Teen Suicides, Google’s Gemini, and the Moral Failure of AI for Kids (https://hackernoon.com/the-kids-arent-alright-teen-suicides-googles-gemini-and-the-moral-failure-of-ai-for-kids)

- Do Chatbot Developers Act Responsibly toward their Users? – Balsillie Papers (https://balsilliepapers.ca/bsia-paper/do-chatbot-developers-act-responsibly-toward-their-users/)

- Why AI companions and young people can make for a dangerous mix – Stanford Medicine (https://news.stanford.edu/stories/2025/08/ai-companions-chatbots-teens-young-people-risks-dangers-study)

- AI Chatbot Suicide Lawsuits (https://www.levylaw.com/)

- Digital companions, real casualties: A commentary on rising AI-related mental health crises (https://www.probiologists.com/abstract/digital-companions-real-casualties-a-commentary-on-rising-ai-related-mental-health-crises)

- Preliminary Report on Dangers of AI Chatbots | Psychiatric Times (https://www.psychiatrictimes.com/view/preliminary-report-on-dangers-of-ai-chatbots)

- Legislative Snapshot: Suicide Prevention Infrastructure and AI Chatbots – ASTHO (https://www.astho.org/communications/blog/2026/legislative-snapshot-suicide-prevention-infrastructure-and-ai-chatbots/)

- AI Chatbot Lawsuits and Teen Mental Health (https://www.americanbar.org/groups/health_law/news/2025/ai-chatbot-lawsuits-teen-mental-health/)

- SNS 24 – Prevenção do Suicídio (https://www.sns24.gov.pt/pt/tema/prevencao-e-cuidados-de-saude/prevencao-do-suicidio/)

- Regulamento Europeu sobre a IA – AI Act (https://digital.gov.pt/pt/regulamentacao/ai-act)

Google Académico:

(PDF) Digital companions, real casualties: A commentary on rising AI-related mental health crises – ResearchGate

(PDF) The Digital Crisis Interface: A Longitudinal Analysis of Generative Artificial Intelligence in Suicidology and Crisis Intervention

Se gostou deste artigo e o achou interessante. Dê-nos o seu “GOSTO“, partilhe-o com os seus amigos e familiares. Este site serve para isso mesmo: elucidar, ensinar e relembrar algum assunto a quem gosta de Informática e tecnologia.

Este site já conta mais de sessenta artigos que podem ser do seu interesse. Vá para o menu deste site e veja o Menu de Artigos e faça as suas escolhas.

IMPORTANTE: Se é profissional de saúde ou educador, partilhe este artigo para consciencializar sobre o uso ético da IA. Saiba que existem linhas de apoio disponíveis 24 por dia se conhecer alguém que necessite de ajuda ou apresente sinais de saúde mental.

Para além de poder comentar pode sempre enviar um e-mail para formacaoajuda@gmail.com para qualquer dúvida ou esclarecimento.

Obrigado.

One comment