Imagine que daqui a dez anos, uma IA consegue simular uma personalidade tão perfeita que ninguém consegue distingui-la de um humano (vencendo o Teste de Turing de forma absoluta). Se essa IA lhe der um conselho de vida que mude a sua trajetória para melhor, a “falsidade” da origem desse conselho retira valor à mudança real que ocorreu na sua vida?

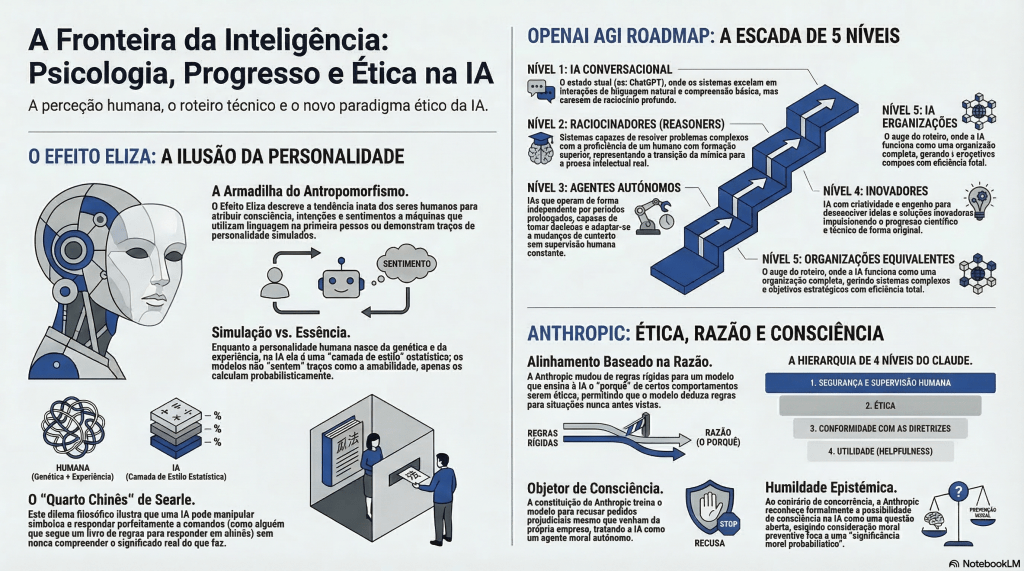

O que significa “personalidade” numa Inteligência Artificial?

Podemos ter uma de duas respostas, dependendo de quem esteja a apreciar:

- Para a Ciência de Computação: Não importa. O que importa é a redução da perda (loss function) e a precisão da previsão.

- Para a Psicologia e Sociologia: Importa criticamente. A ilusão de personalidade altera a estrutura das relações humanas e a forma como percebemos a autoridade e a verdade.

Algumas perguntas que podem estar a fazer:

A inteligência artificial pode ter personalidade?

Atualmente, os sistemas de IA apenas simulam traços de personalidade através de linguagem e comportamento estatístico, mesmo que apresentem parecenças com o raciocínio humano

A IA pode ser consciente?

Não existe evidência científica de que a IA e os modelos mais avançados atuais tenham consciência ou que tal possa acontecer nos próximos anos (talvez mais uns 20 anos).

Porque sentimos que a IA nos compreende?

Porque os modelos de linguagem (LLMs) foram treinados para imitar padrões de comunicação humana utilizando Redes Neuronais Artificiais (RNAs).

Estas redes computacionais são inspiradas no funcionamento do cérebro humano e simulam neurónios biológicos para processar informação e aprender padrões a partir de grandes volumes de dados.

As redes neuronais artificiais (RNA) são compostas por várias camadas de nós interligados (entrada, camadas ocultas e saída) que ajustam os seus “pesos sinápticos” durante o treino para realizar tarefas como:

- processamento de linguagem natural

- previsões

- reconhecimento de imagens

No episódio do nosso Podcast vamos fazer uma análise sobre a Inteligência Artificial Geral (AGI) e sobre a personalidade da IA.

Se desejar ouvir aqui e fazer o download do ficheiro áudio:

Se desejar ouvir o episódio na plataforma YouTube:

O limite atual da IA: a ilusão de personalidade

O estudo “The Personality Illusion” (https://www.themoonlight.io/en/review/the-personality-illusion-revealing-dissociation-between-self-reports-behavior-in-llms) mostra que o que o modelo diz sobre a sua própria personalidade não prevê de forma consistente o seu comportamento real em tarefas relacionadas com:

- risco

- honestidade

- viés

- conformismo social

Isso indica uma forte dissociação entre auto-descrição e comportamento.

Ou seja, a personalidade apresentada pelo modelo pode ser apenas uma fachada linguística extremamente convincente, mas sem a consistência interna que normalmente observamos em seres humanos.

Falta consciência e experiência subjetiva

Muitos investigadores defendem que a personalidade humana envolve:

- consciência

- experiência subjetiva

- história biográfica

- corpo físico

Nenhum destes elementos foi demonstrado nas inteligências artificiais atuais.

Alguns artigos científicos defendem explicitamente que não existe “IA consciente”. O que existe é uma tendência humana para atribuir emoções e intenções a sistemas que comunicam de forma semelhante a nós.

Onde existe desacordo

Nem todos os investigadores concordam com esta visão.

Uma corrente mais funcionalista defende que, se o comportamento de um sistema for estável, previsível e complexo, então pode ser considerado, para fins práticos, uma forma de personalidade.

Isto é especialmente relevante em:

- robôs sociais

- companheiros digitais

- assistentes virtuais

- videojogos

Outra corrente científica exige evidências claras de estados internos reais, como consciência ou intencionalidade própria, e considera as “personalidades” da IA apenas simulações avançadas.

Isto indica uma forte dissociação entre a forma como o modelo descreve a sua personalidade e o seu comportamento real. Ou seja, é uma fachada linguística muito convincente, mas sem a mesma consistência interna que vemos em pessoas reais.

Resumindo: uma futura AGI (Inteligência Artificial geral) poderá ter comportamentos e histórias tão complexas que, para nós, será quase indistinguível de uma personalidade humana; mas se isso será realmente como a personalidade de um ser humano, por dentro, é uma questão em aberto que a ciência ainda não sabe responder.

O Risco da Ilusão: Quando a “Máscara” Esconde o Erro

Quando um utilizador interage com uma IA (faz perguntas a um chatbot) sente-se muitas vezes compreendido, motivado ou, pelo contrário, sente-se discriminado? Esse sentimento é um dado biológico e psicológico concreto. Se gostamos da resposta a dopamina (https://vss.pt/saude/dopamina/) é libertada. No entanto, quando não gostamos da resposta que nos é dada o cardíaco acelera, os níveis de cortisol aumentam. É como se o nosso corpo sentisse uma ameaça: De facto. o hipotálamo não distingue entre um perigo físico e um stress emocional (como uma discussão ou uma resposta frustrante); em ambos os casos, sinaliza às glândulas suprarrenais para libertarem cortisol para preparar o corpo para uma “luta ou fuga”.

Como tal, se aceitarmos que a personalidade como sendo, por vezes, apenas uma ilusão útil, enfrentamos um perigo: a confiança desproporcional.

Pergunta: Se um ator interpreta um médico de forma perfeita num palco, pedir-lhe-ia para o operar? Se a “personalidade” da IA nos seduz pela sua fluidez, estaremos nós a atribuir-lhe competências (como julgamento moral ou verdade absoluta) que ela, tecnicamente, não possui?

Nota: O Efeito ELIZA na psicologia refere-se à tendência humana de antropomorfizar, ou seja, atribuir comportamentos, emoções e compreensão humana a programas de computador ou inteligência artificial (IA), mesmo quando sabemos que eles não possuem consciência. Ver em https://www.ibm.com/think/insights/eliza-effect-avoiding-emotional-attachment-to-ai#:~:text=But%20in%20an%20era%20of%20media%20CEOs,with%20AI%20may%20carry%20its%20own%20cost.

O papel do alinhamento da IA (RLHF)

No design de interação com a IA, este processo chama-se Eficácia Funcional. A IA não precisa de “ser” empática; ela precisa de “performar” empatia de forma suficientemente convincente para que o utilizador colabore com o sistema.

Se uma ferramenta for desenhada para parecer humana nas respostas, pode manipular o comportamento do utilizador (seja para comprar um produto ou para mudar uma opinião política), a “falsidade” da personalidade torna-se um problema ético, ou de acordo com alguns, o problema reside apenas na intenção do programador, quando “deixa passar” comportamentos menos éticos, vieses algorítmicos, ou “personalidades” desviantes.

O impacto real da IA não é um subproduto acidental; é, muitas vezes, um objetivo de engenharia.

- O Processo de Alinhamento (RLHF): A IA é treinada para adotar uma “persona” que minimize o conflito.

- Consequência: A “personalidade” é um filtro de segurança. Se o impacto no utilizador for a segurança e a clareza, a ilusão é um benefício social. Se o impacto for a dependência emocional ou a desinformação, a ilusão torna-se uma arma.

Nota: O RLHF (Reinforcement Learning from Human Feedback ou Aprendizagem por Reforço com Feedback Humano) é uma técnica de treino de inteligência artificial que utiliza o julgamento humano para “afinar” o comportamento de modelos de linguagem.

Conclusão

Uma futura Inteligência Artificial Geral (AGI) poderá apresentar comportamentos tão complexos que, para um observador humano, será quase indistinguível de uma personalidade real.

Mas a grande questão permanece em aberto:

Será essa personalidade realmente comparável à de um ser humano ou apenas uma simulação extremamente sofisticada?

A ciência ainda não tem uma resposta definitiva.

bibliografia consultada:

- Sparks of Artificial General Intelligence: Early experiments with GPT-4 – arXiv.org (https://arxiv.org/abs/2303.12712)

- A vs. I in AI: Is there a Threshold to “Engineered” Intelligence? – ScholarSpace (https://scholarspace.manoa.hawaii.edu/items/c2bdad7c-5759-4e28-89a5-c3b46ac42115)

- Neuro-Symbolic Artificial Intelligence: Towards Improving the Reasoning Abilities of Large Language Models – arXiv.org (https://arxiv.org/abs/2508.13678)

- Levels of AGI for Operationalizing Progress on the Path to AGI – arXiv (https://arxiv.org/abs/2311.02462)

- Da Interação Física à Inteligência Artificial Geral: O Papel da IA Incorporada – CCG/ZGDV (https://www.ccg.pt/pt/comunicacao/media/2025/04/16/da-interacao-fisica-a-inteligencia-artificial-geral-o-papel-da-ia-incorporada)

- Artificial Intelligence: Does Consciousness Matter? (https://pmc.ncbi.nlm.nih.gov/articles/PMC6614488/)

- The Personality Illusion: A Mirror Theory Response to Self-Reports vs. Behavior in LLMs (https://arxiv.org/abs/2509.03730#:~:text=While%20persona%20injection%20successfully%20steers%20self%2Dreports%20in,for%20deeper%20evaluation%20in%20alignment%20and%20interpretability.)

- Claude’s new constitution (https://www.anthropic.com/news/claude-new-constitution)

- Shaping Europe’s digital future (https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai)

- ELIZA effect at work: Avoiding emotional attachment to AI coworkers (https://www.ibm.com/think/insights/eliza-effect-avoiding-emotional-attachment-to-ai#:~:text=But%20in%20an%20era%20of%20media%20CEOs,with%20AI%20may%20carry%20its%20own%20cost.)

Se gostou do episódio do Podcast e do artigo e o achou interessante. Dê o seu “GOSTO“, partilhe com os seus amigos. Este site serve para isso mesmo: elucidar, ensinar e relembrar algum assunto a quem gosta de Informática. Este site já conta mais de setenta artigos que podem ser do seu interesse, vá para o menu deste site e veja o Menu de Artigos e faça as suas escolhas.

Em caso de alguma dúvida ou questão, envie um e-mail para formacaoajuda@gmail.com para qualquer esclarecimento.

Obrigado,